16 de abril de 2026

El retraso en las respuestas es uno de los mayores obstáculos en la automatización de llamadas con IA. Cuando un usuario habla y el sistema tarda varios segundos en procesar y emitir una respuesta, la conversación se rompe. Este fenómeno, conocido como "lag", destruye la naturalidad de la interacción y genera frustración en el usuario final.

En el ámbito comercial y de atención al cliente, los milisegundos importan. Un retraso perceptible elimina la confianza del cliente, afectando directamente las métricas de negocio. Las empresas que gestionan altos volúmenes de interacciones necesitan sistemas que respondan con la misma inmediatez que un operador humano.

La clave para que una inteligencia artificial suene realmente humana no reside únicamente en la calidad de su modelo de lenguaje, sino en la velocidad de su infraestructura.

En este artículo, analizaremos desde una perspectiva técnica cómo una arquitectura de baja latencia permite que el voice AI en tiempo real funcione de manera fluida y escalable.

¿Qué es la latencia en sistemas de voz con IA?

La latencia en la automatización de llamadas con IA se define como el tiempo transcurrido desde que el usuario termina de hablar hasta que el sistema comienza a reproducir su respuesta de audio.

Para lograr una experiencia conversacional fluida, este intervalo debe mantenerse por debajo de los umbrales de percepción humana, típicamente alrededor de los 500 milisegundos.

Tipos de latencia en el procesamiento de voz

El retraso total de un sistema se compone de varios micro-retrasos acumulados en distintas fases del pipeline de procesamiento. Las principales etapas son:

- Captura y transmisión de audio: El tiempo que tarda el audio del usuario en viajar desde la red telefónica hasta los servidores de procesamiento.

- Procesamiento (ASR, NLP, decisión): Incluye el reconocimiento automático de voz (ASR) para convertir audio a texto, el procesamiento de lenguaje natural (NLP) para comprender la intención y la lógica de decisión para generar una respuesta textual.

- Generación de respuesta (TTS): El proceso de síntesis de texto a voz (Text-to-Speech) que convierte la respuesta generada por la IA nuevamente en un formato de audio reproducible.

Impacto en la experiencia del usuario y conversiones

La latencia elevada en las llamadas automatizadas rompe el flujo natural de la comunicación humana. Los humanos dependemos de señales de tiempo precisas para saber cuándo es nuestro turno de hablar.

Cuando los agentes de voz inteligentes presentan retrasos, ocurren tres problemas fundamentales:

- Conversaciones poco naturales: Las pausas prolongadas generan incomodidad y hacen evidente que el usuario está hablando con un bot deficiente.

- Pérdida de confianza: Los usuarios asumen que el sistema ha fallado o no ha comprendido su solicitud.

- Abandono de llamadas: La fricción generada por el lag incrementa exponencialmente las tasas de abandono, impactando de forma directa en las métricas de retención y conversión.

Componentes clave de una arquitectura low-latency

Para ejecutar la baja latencia en inteligencia artificial a escala empresarial, es necesario diseñar una infraestructura altamente optimizada. No basta con utilizar modelos de IA estándar; la arquitectura debe minimizar cada milisegundo en el ciclo de vida de la solicitud.

Procesamiento en tiempo real y pipelines paralelos

Los sistemas tradicionales procesan el audio en bloques (batch), lo que añade retrasos significativos. Una arquitectura moderna utiliza el procesamiento en streaming. Esto significa que el procesamiento de voz en tiempo real comienza a analizar el audio mientras el usuario todavía está hablando.

Además, los pipelines paralelos permiten que tareas como el ASR y el motor de razonamiento lógico se ejecuten de manera simultánea o solapada. Mientras se transcribe la última palabra, el modelo ya está formulando la estructura de la respuesta.

Manejo de interrupciones (Barge-in)

Una característica técnica crítica es el barge-in. Esto permite al usuario interrumpir a la IA en cualquier momento. El sistema debe ser capaz de detener instantáneamente su reproducción de audio, limpiar su contexto de generación y comenzar a escuchar la nueva entrada del usuario sin latencia añadida.

Infraestructura distribuida y edge computing

Ubicar los servidores de procesamiento cerca de los nodos de telecomunicaciones reduce la latencia de red. El uso de infraestructuras distribuidas y edge computing asegura que los paquetes de audio viajen la menor distancia física posible antes de ser procesados por los algoritmos de IA.

Cómo funciona una conversación en milisegundos

El flujo técnico detrás de una interacción en tiempo real requiere sincronización absoluta entre múltiples componentes:

- Ingesta: El usuario habla y el audio se transmite en fragmentos de pocos milisegundos a través de protocolos SIP/RTP.

- Transcripción concurrente: El motor ASR transcribe el flujo de audio en tiempo real.

- Análisis predictivo: Antes de que el usuario termine su frase, el sistema anticipa posibles intenciones.

- Generación de TTS en streaming: Una vez que el LLM genera los primeros tokens de la respuesta, el motor TTS comienza a sintetizar el audio y lo envía de vuelta al usuario, sin esperar a que la oración completa esté redactada.

Impacto en performance comercial

La implementación de estas técnicas resulta en un incremento directo en el engagement del usuario. Al percibir una comunicación fluida, los clientes están más dispuestos a completar el flujo estructurado de la llamada, lo que se traduce en un incremento cuantificable en las tasas de conversión y una mejora sustancial en la percepción de marca.

Rootlenses Voice: Respuestas humanas para tu negocio

La latencia es un factor crítico y un diferenciador técnico fundamental en el mercado de Voice AI. La experiencia humana en la IA conversacional no depende únicamente de utilizar las palabras correctas, sino de entregarlas a la velocidad adecuada.

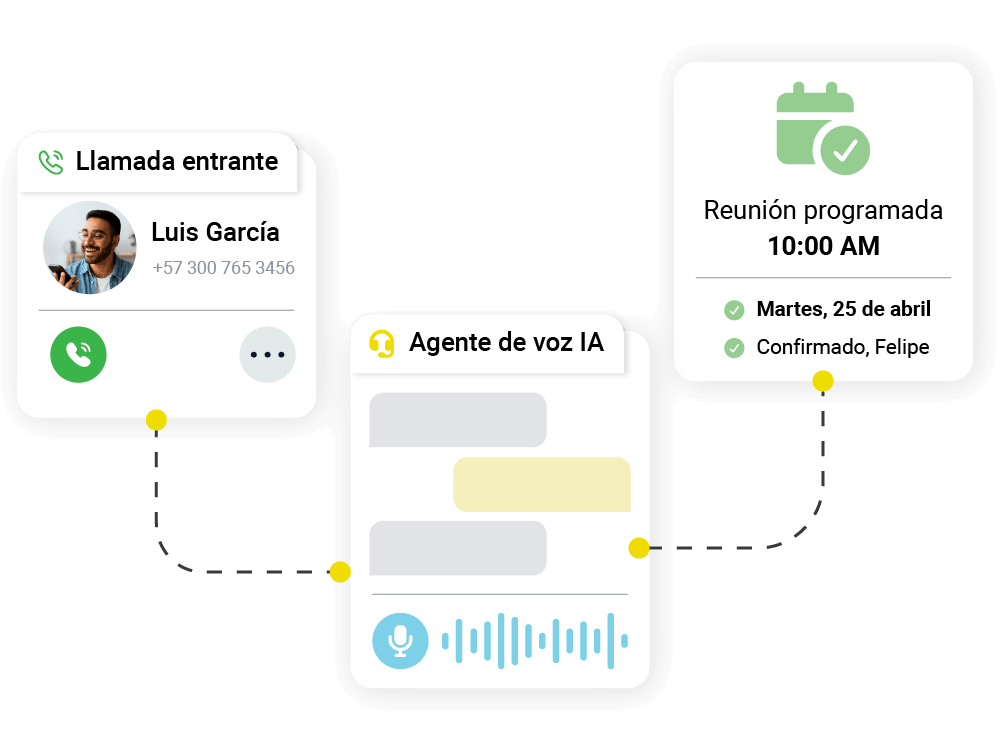

En Rootlenses Voice, hemos desarrollado una plataforma de orquestación de llamadas que centraliza y automatiza flujos de trabajo de alto volumen. Nuestra arquitectura de IA garantiza escalabilidad sin sacrificar velocidad, gestionando la concurrencia de llamadas con precisión operativa y mínima latencia.

Si tu empresa busca escalar sus operaciones telefónicas eliminando cuellos de botella y manteniendo interacciones de alta calidad, es momento de integrar tecnología diseñada para operar en tiempo real.