24 de marzo de 2026

En el despliegue de agentes de voz con inteligencia artificial en salud, la latencia no es solo un problema técnico: es un problema de confianza.

En múltiples discusiones en comunidades técnicas y foros como Reddit, los usuarios reportan una experiencia consistente: pausas incómodas, respuestas tardías y conversaciones que se sienten “no naturales”. En un entorno como el de salud, donde la precisión, la empatía y la claridad son críticas, estos problemas impactan directamente:

- La confianza del paciente

- La fluidez en procesos como agendamiento

- La calidad percibida del servicio

Este artículo desglosa qué es realmente la latencia en agentes de voz con IA, por qué ocurre y cuáles son las mejores prácticas técnicas para minimizarla en entornos clínicos.

¿Qué es la latencia en agentes de voz con IA?

La latencia en una llamada con IA es el tiempo total entre que el usuario habla y recibe una respuesta audible del sistema.

Este tiempo se compone de múltiples capas:

- Speech-to-Text (STT): convertir voz en texto

- Procesamiento del LLM: interpretación + generación de respuesta

- Orquestación (lógica de negocio): validaciones, consultas a sistemas clínicos, agendas

- Text-to-Speech (TTS): conversión de texto a voz

- Red / telecomunicaciones: transmisión de audio

Incluso pequeñas demoras en cada capa se acumulan, generando una experiencia fragmentada.

Por qué la latencia impacta directamente la confianza del paciente

En salud, la conversación no es solo funcional, es emocional.

Una latencia alta genera:

- Sensación de que el sistema “no entiende”

- Interrupciones en momentos críticos (síntomas, urgencias)

- Percepción de baja calidad tecnológica

- Desconfianza sobre el manejo de información sensible

Insight clave:

El usuario no mide milisegundos. Mide fluidez.

Si una conversación no fluye, el paciente asume que el sistema no es confiable, incluso si técnicamente es preciso.

Latencia y su efecto en el agendamiento médico

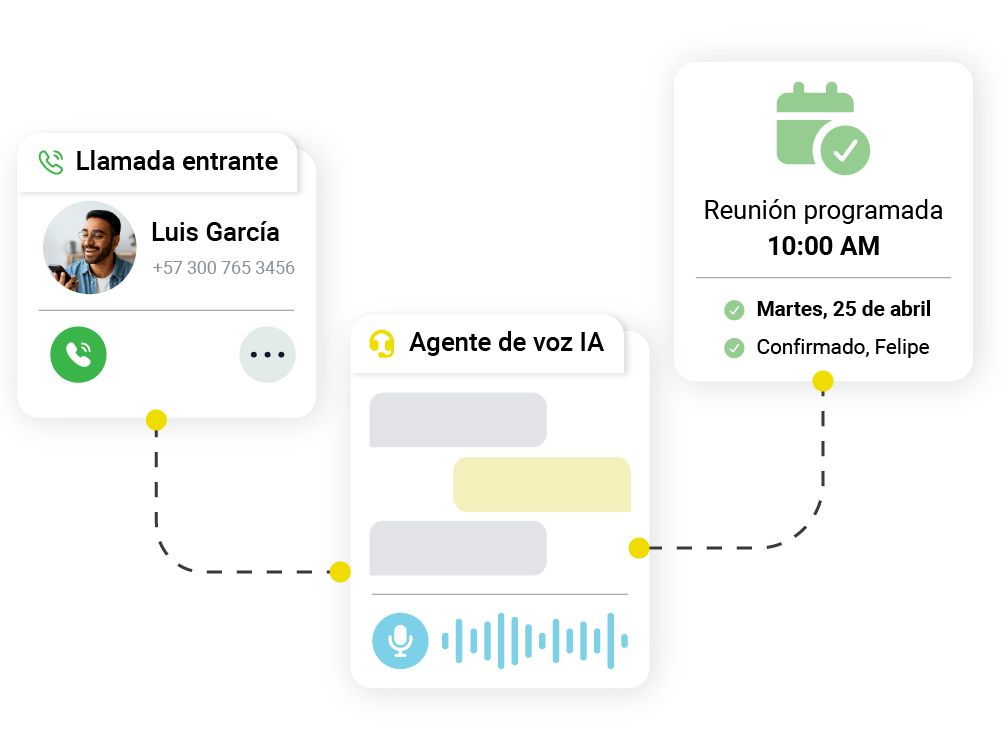

Uno de los principales casos de uso de agentes de voz en salud es el agendamiento.

Aquí la latencia impacta directamente en:

- Abandono de llamadas: pausas largas reducen la tasa de finalización

- Errores en captura de datos: el usuario repite información o se confunde

- Duración de llamadas: mayor costo operativo

- Conversión: menor tasa de citas confirmadas

Una interacción fluida puede reducir significativamente el tiempo de llamada y aumentar la eficiencia operativa.

Componentes técnicos donde se genera la latencia en los agentes de voz con IA

Para optimizar, primero hay que entender dónde ocurre.

1. Modelos de Speech-to-Text (STT)

- Latencia depende de:

- Tamaño del modelo

- Procesamiento en batch vs streaming

- Tamaño del modelo

- Problema común: esperar a que el usuario termine de hablar completamente

Mejor práctica: usar STT en tiempo real (streaming partial transcripts)

2. Inferencia del LLM

- Es el componente más costoso en tiempo

- Factores clave:

- Tamaño del modelo

- Longitud del contexto

- Complejidad del prompt

- Tamaño del modelo

Problema frecuente: prompts sobredimensionados con demasiada lógica

3. Integraciones backend

- Consultas a:

- Sistemas de agenda

- EHR/EMR

- Validaciones de seguros

- Sistemas de agenda

Riesgo: APIs lentas que bloquean la respuesta

4. Text-to-Speech (TTS)

- Modelos más naturales suelen ser más lentos

- Generación completa vs streaming

5. Orquestación del agente

- Manejo de turnos conversacionales

- Decisión de cuándo responder

Mejores prácticas técnicas para reducir la latencia

1. Implementar arquitectura en streaming end-to-end

En lugar de esperar a que cada componente termine:

- STT → enviar transcripciones parciales

- LLM → generar respuestas incrementales

- TTS → reproducir audio mientras se genera

Resultado: reducción drástica de percepción de espera

2. Diseñar prompts optimizados y modulares

- Reducir tokens innecesarios

- Separar lógica en capas (no todo en el prompt)

- Usar instrucciones claras y concisas

Regla práctica: menor contexto = menor latencia

3. Uso de modelos híbridos

No todo requiere un LLM grande.

- Clasificación → modelos pequeños

- Respuestas estructuradas → templates

- LLM solo para casos complejos

Esto reduce significativamente el tiempo de inferencia.

4. Cacheo inteligente de respuestas

Casos comunes en salud:

- Horarios

- Ubicaciones

- FAQs

Preprocesar y cachear reduce llamadas al modelo.

5. Optimización de integraciones

- Uso de APIs asincrónicas

- Pre-fetching de datos relevantes

- Timeouts controlados

Ejemplo: cargar disponibilidad antes de que el usuario la solicite explícitamente.

6. Control de turn-taking conversacional

Uno de los mayores problemas en percepción de latencia:

- El agente responde demasiado tarde

- O interrumpe al usuario

Solución:

- Detectar pausas naturales (endpointing)

- Ajustar sensibilidad de silencio

- Permitir “barge-in” (interrupciones del usuario)

7. Infraestructura cercana al usuario (edge / región)

- Reducir latencia de red

- Desplegar servicios en regiones cercanas al paciente

Especialmente relevante en sistemas de salud distribuidos.

8. Monitoreo en tiempo real de latencia

No se puede optimizar lo que no se mide.

Métricas clave:

- Tiempo total de respuesta

- Tiempo por componente (STT, LLM, TTS)

- Tasa de abandono

- Duración promedio de llamada

Latencia vs fluidez: el verdadero KPI

Reducir milisegundos no es suficiente.

El objetivo real es:

Mantener una conversación natural, continua y confiable

Esto implica:

- Respuestas oportunas

- Ritmo conversacional humano

- Capacidad de sostener contextos largos sin degradación

La fluidez percibida es el verdadero indicador de éxito.

¿Pueden los agentes de IA sostener conversaciones largas en salud?

Sí, pero bajo ciertas condiciones técnicas:

- Manejo eficiente de contexto (windowing, memoria selectiva)

- Resumen dinámico de conversaciones largas

- Separación entre memoria activa y memoria histórica

El problema no es la capacidad del modelo, sino la arquitectura que lo soporta.

Conclusión: la latencia como ventaja competitiva

En el sector salud, donde la experiencia del paciente es crítica, la latencia deja de ser un problema técnico para convertirse en un diferenciador estratégico.

Las organizaciones que invierten en optimizarla logran:

- Mayor confianza del paciente

- Mejor eficiencia operativa

- Mayor tasa de conversión en procesos clave como agendamiento

Sobre Rootlenses Voice

Rootlenses Voice es un agente de voz con inteligencia artificial diseñado para automatizar llamadas en industrias complejas como salud, combinando:

- Arquitecturas optimizadas para baja latencia

- Conversaciones fluidas y naturales

- Integración segura con sistemas clínicos

- Monitoreo y analítica en tiempo real

El resultado: experiencias que no solo funcionan, sino que generan confianza en cada interacción.